國際政策趨勢

華爾街日報指出FB打擊仇恨言論的AI 並未達到其宣稱的功效

Facebook公司的高層長期以來一直表示,AI能解決該公司目前所存在的問題,將其所認定的仇恨言論、暴力行為和未成年使用者排除在該公司的社交平台之外。

但根據《華爾街日報》日前的報導,這願景可能比該公司高層暗示的還要來得遙遠。Facebook的AI無法識別出以第一人稱為視角所拍攝的槍擊影片和種族主義言論,甚至無法辨識出鬥雞和車禍之間的差別。

且在《華爾街日報》所引用的內部文件中顯示,該公司的自動化系統只刪除了一小部分的仇恨貼文,而其比例可能只有個位數。當演算法無法識別貼文內容是否違反規定,該將其刪除與否之時,平台會減少該貼文的曝光度,但發布該貼文的帳號卻不會受到任何懲罰。

此外,在兩年前Facebook就已經減少人工審查仇恨內容投訴的時間,並進行其他調整以降低整體投訴數量。這使得該公司更加依賴AI來執行其平台守則,並在公開的統計數據中誇大其成效。

一位Facebook工程師預估該公司的自動化系統所刪除的貼文比例,可能只占所有仇恨言論貼文的2%,更表示除非Facebook的策略進行重大的變更,否則在中短期內很難將其比例提升至10-20%以上。

在今年3月,另一組Facebook團隊也得出了類似的結論,認為該公司的自動化系統只刪除了3-5%的仇恨言論貼文,而暴力以及煽動行為的貼文更是只有0.6%。

民權團體和學者長久以來對於AI偵測率顯示出來的進展,都抱持著懷疑的態度,並表示這似乎與使用者的體驗或是他們的研究不相符。「Facebook永遠都不會揭露出他們在做的事。」民權團體Color of Change的會長Rashad Robinson如此表示。在去年,因Facebook未能有效的控制仇恨言論,該團體協助舉辦了一場廣告商的抵制活動。

對此Facebook誠信部門的副總Guy Rosen透過官方部落格表示,仇恨言論在Facebook的盛行率在過去3季中下降了近50%。而且僅透過貼文的刪除來看Facebook如何打擊仇恨言論,是錯誤的方式。Facebook對於自動化系統刪除貼文有著很高的標準,如果不這麼做將有可能造成許多的錯誤,「從而傷害到我們試圖保護的人,例如那些描述仇恨言論經驗或是譴責仇恨言論的人們」。

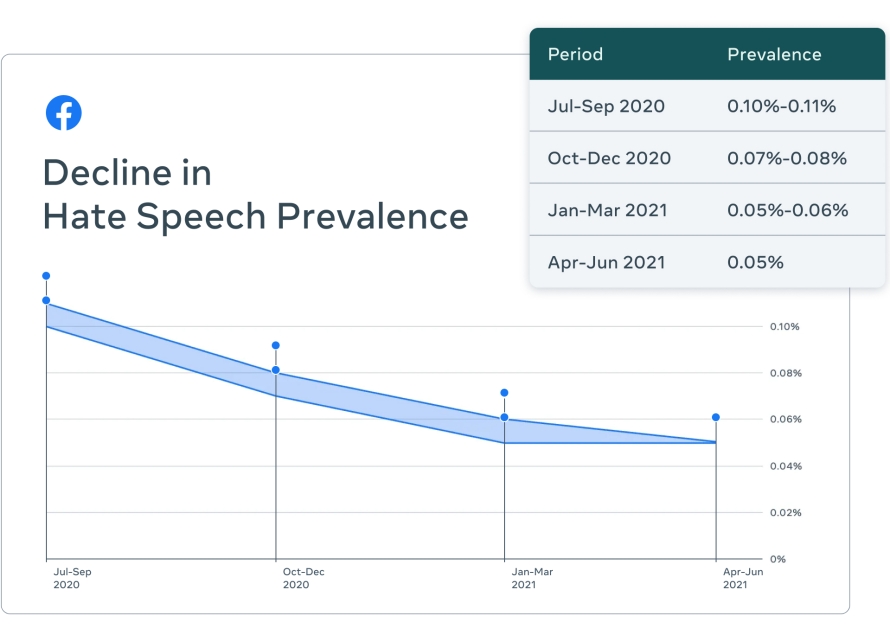

而根據Facebook最新的《社群守則執行報告》,仇恨言論貼文的盛行率只占所有瀏覽量的0.05%,換句話說就是每1萬人中僅有5個人看到仇恨言論貼文,比起2020年的0.1%下降了近50%。

(圖片來源:Facebook)

但《華爾街日報》獲得的內部文件顯示,某些應該被偵測出來的重大事故貼文卻被AI遺漏掉了,如槍擊事件的特寫、拍攝到傷患的嚴重車禍影片、針對跨性別兒童的暴力威脅等。

《華爾街日報》也依據這些文件和員工的採訪,撰寫出一系列的報導。包括該公司給與社會名流、政治人物和網紅的特別待遇,其演算法如何助長紛爭,早已清楚販毒集團和人口販運者在公開使用其服務,以及其平台如何被反疫苗運動者所利用等。而一篇IG如何影響青少女心理健康的文章,也促使了美國參議院在九月底舉行聽證會。

參考資料

https://about.fb.com/news/2021/10/hate-speech-prevalence-dropped-facebook/